Genomskinlig maskininlärning: att få AI att förklara sina beslut

- Jag erbjuder konsulttjänster inom maskininlärning, AI och statistik – bland annat hjälper jag företag med öppna sina ”black box”-modeller. Kontakta mig för att få veta mer.

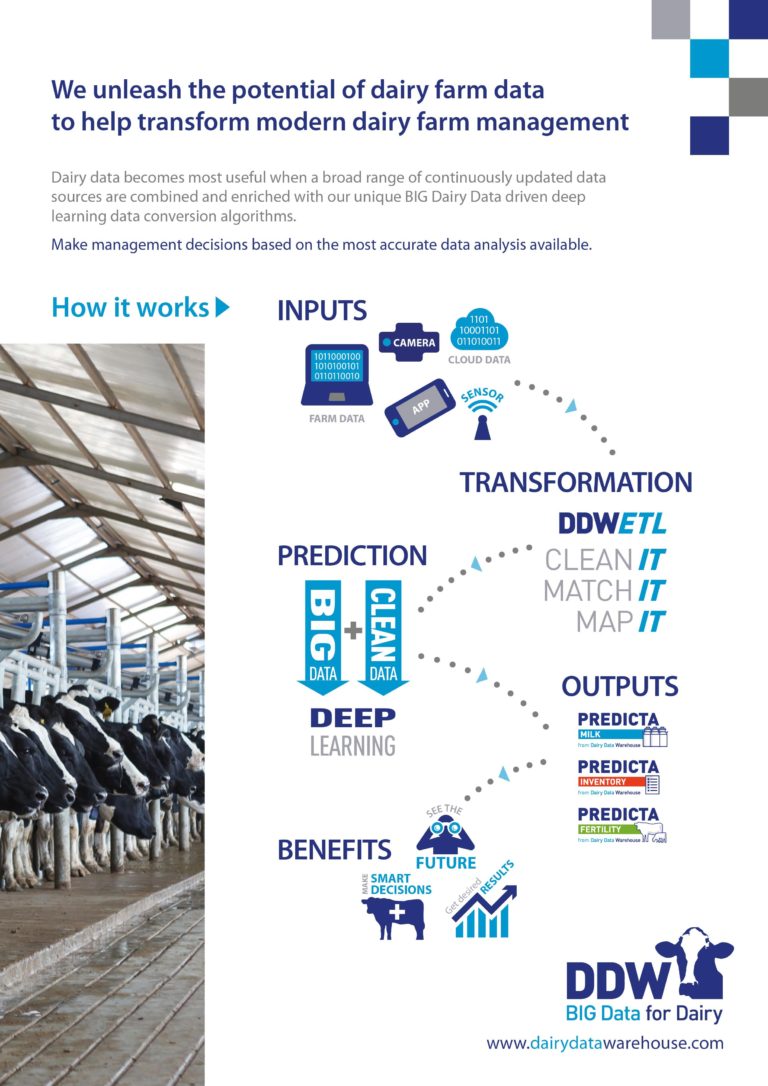

I våras hjälpte jag Dairy Data Warehouse att utveckla olika prognossystem för mjölkindustrin. I förra veckan lanserades några av de här systemen på den ledande mässan inom djurhållning: EuroTier i Hannover. De system jag varit med och utvecklat använder AI i form av djupinlärning (deep learning), där data från en rad olika källor (mjölkningsrobotar, fodersystem, avelsdatabaser, m.m.) vägs ihop för att göra prognoser för exempelvis hur mycket mjölk en ko kommer att ge det närmaste året.

Systemen kommer att kunna användas på flera olika sätt. Bonden kommer att få bättre underlag för att bedöma vilka djur hon ska behålla och för hur ekonomin kommer se ut framöver. Mejerierna kommer att få bättre uppskattningar av hur mycket mjölk de ska hämta olika dagar och kan därmed bättre planera de rutter som tankbilarna åker, med både ekonomiska och miljömässiga vinster.

Dagens mjölkindustri är teknikintensiv och full av system som samlar in data av olika slag. Dairy Data Warehouse har byggt upp en unik databas där data från alla dessa system samlas på ett och samma ställe. Med hjälp av den databasen har vi också utvecklat system som ska ge bättre djurhälsa och som knyter an till internet of things i ladugården och på mejeriet. Mer om det kommer en annan gång.

I dagarna har det rapporterats om att Amazon lagt ner ett projekt där AI skulle användas för att sålla bland kandidater vid rekryteringar (IDG, Reuters). Anledningen är att AI-verktyget började diskriminera kvinnor och föredra manliga sökande.

Men hur kan en dator lära sig att diskriminera? Svaret finns i våra data.

Statistiker världen över har ägnat årtionden åt att fundera över hur man på bästa sätt ska samla in data för att kunna ge svar på de frågor man undrar över. Det finns många fallgropar när det gäller datainsamling. Två av dem är:

Om man inte undviker fallgroparna så riskerar man att lura både sig själv och andra. Det gäller oavsett om man utför opinionsundersökningar eller utvecklar AI-verktyg för rekrytering.

I fallet med Amazons rekryterings-AI så finns det tecken på att de fallit i båda de ovan nämnda fallgroparna:

Att låta sökande bedömas av ett AI-verktyg är i teorin en jättebra idé. Datorn kan vara opartisk, rättvis och ge alla samma chans. Men om de data som används för att bygga upp verktyget inte är opartiska, rättvisa och ger alla samma chans blir effekten den motsatta. AI:n löser i så fall inte problemet med diskriminering – tvärtom cementerar den diskrimineringen.

Diskriminerande AI-system är på intet sätt något som är unikt för rekryteringsverktyg – ett annat exempel från i år är ansiktsigenkänningssystem som fungerar mycket bättre för vita män än för personer med annat kön eller annan hudfärg. Värt att understryka är att Amazon på eget bevåg lade ned projektet med AI-verktyg för rekrytering. Men hur många företag har gått och kommer gå vidare med AI-projekt utan att förstå vikten av att inte bygga in diskriminering i dem? Vad kommer de och vi att gå miste om när systemen fattar beslut på felaktiga grunder? Och hur kommer reaktionerna att bli när problemen med deras system avslöjas?

Att skriva om översvämningar känns en smula märkligt efter en rekordvarm sommar med torka och skogsbränder (även om Uppsala centralstation översvämmades av störtregn i slutet av juli). Men vad annat kan jag göra när Wired skriver en spännande artikel om hur AI kan användas för att förebygga just översvämningar? Och eftersom vi kan förvänta oss mer extremt väder i takt med att planeten blir allt varmare så kan vi inte börja tänka på den här sortens frågor snart nog.

Sommaren har varit varm och torr.

I Wired-artikeln beskrivs hur man med hjälp av AI skapat en karta som kan användas för att övervaka risken för översvämningar. I texten kan man plocka upp tre punkter som är återkommande för i stort sett alla AI-projekt:

Neurala nätverk och andra populära AI-verktyg är fantastiska när vi vill automatisera olika rutinartade uppgifter, men kan få problem när de ställs inför helt nya situationer. Eller när man ber dem att komma med prognoser för vad värsta möjliga utfall är. Ett exempel är frågan om hur högt vattenståndet som högst kommer vara i Fyrisån de kommande hundra åren. Svaret på den frågan är enormt viktigt när man planerar bebyggelse kring ån – vi kan inte nöja oss med att undvika översvämningar ett genomsnittligt år utan måste förstås bygga med marginal så att vi även slipper dem de år då vattnet står som högst. Här räcker dagens AI-lösningar inte till, men det finns utmärkta matematiska modeller som går att använda för att få en bra uppfattning om hur illa det kan gå. Sådana så kallade extremvärdesmodeller kommer jag att återkomma till i ett framtida blogginlägg (och de kan förresten också användas för att förutspå hur varmt 2000-talets varmaste julimånad kommer vara, eller hur lite regn som kommer falla under århundradets värsta torka).

e-hälsa och digitalisering av vården är 2010-talets melodi och nu börjar vi på allvar se fördelarna med det inom medicinsk diagnostik. Ta patienter som hamnar på sjukhus som ett exempel. Genom åren har flera statistiska modeller för att förutspå mortalitet, oplanerade återbesök och långvarig inläggning på sjukhus tagits fram. Genom att använda information om exempelvis blodtryck, puls, andning och vita blodkroppar kan modellerna med hyfsad noggrannhet avgöra risken att en patient avlider, tvingas komma tillbaka till sjukhuset eller blir kvar i mer än en vecka.

I en intressant artikel från maj i år visar forskare från bland annat Google och Stanford att ett AI-system som kan läsa digitala journaler gör ett betydligt bättre jobb när det gäller att förutspå sådana risker. Artikeln har uppmärksammats stort i media, bland annat av Daily Mail och Bloomberg. Studien ser ut som en triumf för e-hälsa och forskarna ägnar mycket utrymme åt att beskriva fördelarna med djupinlärning, som är den form av AI de använt.

Det är lätt att hålla med om att det här är ett stort kliv framåt för e-hälsa – det visar att datorsystem som tolkar hela journaler istället för några få mätvärden har stor potential. Däremot är det knappast något stort kliv framåt för AI. Den som läser artikeln lite närmare hittar nämligen en jämförelse mellan forskarnas djupinlärningssystem och ett betydligt enklare system som matats med samma journaldata. Det senare använder logistisk regression – en stapelvara inom traditionell statistisk analys, som lärs ut på grundkurser och har funnits sedan 1950-talet. Jämförelsen, som ligger gömd längst ner i artikelns appendix, visar att skillnaden mellan djupinlärning och logistisk regression är minimal (och ser ut att vara inom felmarginalen).

Att lära upp djupinlärningssystem är tidskrävande och kräver mängder av beräkningskraft. Logistisk regression är betydligt enklare att använda, kräver mindre datorkraft och har dessutom fördelen att modellen går att tolka: djupinlärningssystem är så kallade svarta lådor där vi inte vet varför de gör en viss bedömning, medan vi med logistisk regression kan förstå precis varför systemet gör bedömningen. Om båda systemen fungerar lika bra så ska man välja logistisk regression alla dagar i veckan. En produkt som inget vet hur den fungerar är förstås inte lika bra som en produkt som vi kan förstå.

I den här och liknande artiklar kan man just nu skönja två tendenser:

Den dataanalys som använder de häftigaste senaste teknikerna är inte alltid den som är bäst. Det är något som är väl värt att ha i åtanke när ni anlitar konsulter för dataanalys. Ibland är AI och djupinlärning precis rätt verktyg för era problem, men ibland är andra alternativ mycket bättre. Precis som man ska vara försiktig med att anlita en snickare som tror sig kunna lösa alla byggprojekt med bara en hammare så ska man tänka sig för innan man anlitar en konsult som vill lösa alla problem med AI.