Konsten att räkna med det omätbara

I det senaste numret av tidskriften Vatten finns en artikel om rening av enskilda avlopp, där jag hjälpt till med den statistiska analysen. Hushåll som har små egna avlopp måste också ha ett tillhörande reningsverk. I den här studien har man mätt halter av olika partiklar i vattnet som kommer ut från sådana reningsverk, hos mer än 200 hushåll.

För att mäta partikelhalterna har man tagit vattenprover, som sedan skickats till ett laboratorium. Problemet med sådana laboratoriemätningar är att de instrument som används bara kan mäta halter som är tillräckligt stora. Om halten ligger under laboratoriets detekteringsgräns så kan inget mätvärde ges. Istället kan man bara konstatera att halten är lägre än sagda gräns.

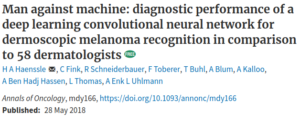

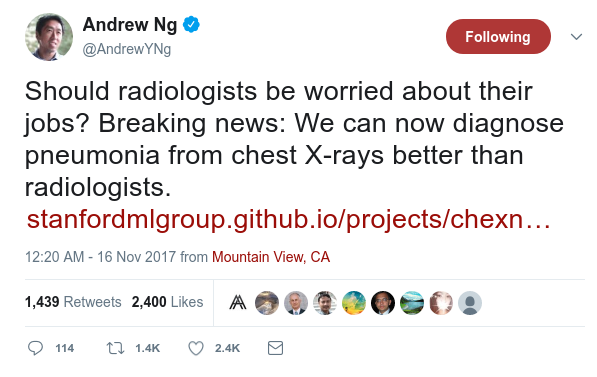

Första gången jag stötte på detekteringsgränser var i ett helt annat sammanhang – i ett projekt med Akademiska sjukhuset i Uppsala. Problemet med detekteringsgränser har nämligen också blivit vanligt inom modern medicinsk forskning, där man ofta är intresserade av halter av olika så kallade biomarkörer (exempelvis protein) i blod eller andra kroppsvätskor. Biomarkörer kan användas för att diagnosticera sjukdomar, välja behandling eller bättre förstå sjukdomsförlopp, men i många fall är halterna för låga för att laboratoriet ska kunna ge något riktigt mätvärde.

Så vad kan vi göra? Vi behöver inte slänga bort mätningarna bara för att vi inte kan få något säkert mätvärde. Vi vet ju faktiskt något om halten av ämnet – nämligen att den ligger under en viss gräns. Det är information som går att använda i vår statistiska analys, men däremot kan vi behöva andra verktyg än de allra vanligaste. Klassiska statistiska verktyg som t-test eller linjär regression stöter ofta på problem när de används på data med detekteringsgränser. Istället kan ickeparametriska metoder eller metoder från överlevnadsanalys användas, men vilken metod som är bäst beror på en rad olika faktorer. Om det har jag tidigare skrivit i den vetenskapliga tidskriften Statistics in Medicine.

En av de roligaste sakerna med att arbeta som statistiker är att man får lära sig om så många olika områden: från avloppsrening till sjukdomsdiagnostik. Och de statistiska problemen är ofta desamma oavsett vilket område data kommer från. Avlopp och blod kan verka som vitt skilda saker, men med statistikerglasögonen på är det knappt någon skillnad.

- Jag har lång erfarenhet av analys av både biomarkörsdata och miljökemiska data. Kontakta mig om ni behöver hjälp med er statistiska analys.